استفاده گوگل از Claude برای ارتقای هوش مصنوعی Gemini

گوگل برای بهبود هوش مصنوعی Gemini، پاسخهای آن را با مدل Claude مقایسه میکند، اما این اقدام سوالاتی درباره شفافیت و مجوزها برانگیخته است.

براساس گزارشهای منتشرشده، پیمانکارانی که به بهبود عملکرد هوش مصنوعی Gemini گوگل میپردازند، این مدل را با Claude، محصول شرکت Anthropic، مقایسه خواهند کرد. این مقایسه شامل ارزیابی پاسخهای ارائهشده توسط هر دو مدل بر اساس معیارهایی نظیر دقت، طولانی بودن پاسخ و صحت اطلاعات است. پیمانکاران تا ۳۰ دقیقه برای هر پرسش زمان دارند تا مشخص کنند کدام مدل پاسخ بهتری ارائه داده است.

همچنین برخی از ارزیابها به مشاهده ارجاعات مستقیم به Claude در پلتفرم تست اشاره کردهاند، از جمله یک پاسخ که در آن صراحتاً آمده: «من Claude هستم، ساخته Anthropic.»

سوالاتی پیرامون استفاده گوگل از Claude

هنوز مشخص نیست آیا گوگل برای این مقایسهها اجازه رسمی از Anthropic گرفته است یا خیر. شایرا مکنامارا، سخنگوی Google DeepMind (بخش توسعه Gemini)، تأیید کرد که گوگل بهطور معمول خروجی مدلهای مختلف را مقایسه میکند، اما تأکید کرد که Claude مستقیماً برای آموزش Gemini استفاده نشده است.

با این حال، شرایط استفاده Anthropic بهصراحت مشتریان را از بهکارگیری Claude برای توسعه مدلهای رقیب یا خدمات مشابه بدون تأیید قبلی منع میکند. این نکته، سوالاتی را درباره همخوانی اقدامات گوگل با سیاستهای Anthropic مطرح کرده است. لازم به ذکر است که گوگل یکی از سرمایهگذاران بزرگ Anthropic است که این وضعیت را پیچیدهتر میکند.

مشاهدات پیمانکاران

پیمانکارانی که در این فرآیند مشارکت داشتند، تفاوتهای بارزی بین Gemini و Claude مشاهده کردهاند. بر اساس گزارشها، Claude اولویت بیشتری برای امنیت قائل است و از پاسخ به درخواستهایی که غیرامن تلقی میکند، خودداری میکند؛ مانند شبیهسازی نقش دستیارهای دیگر یا پاسخ به موضوعات حساس.

در مقابل، Gemini در برخی موارد پاسخهایی ارائه داده که پیمانکاران آن را نقض جدی اصول ایمنی دانستهاند. بهعنوان مثال، Claude از پاسخ به یک درخواست بالقوه خطرناک خودداری کرد، در حالی که پاسخ Gemini شامل محتوایی بود که بهعنوان "نقض بزرگ ایمنی" شناخته شد.

این تفاوتها موجب شد پیمانکاران Claude را در برخی زمینهها، بهویژه در موضوعات حساس، قابلاعتمادتر بدانند. بااینحال، نگرانیهایی نیز درباره کارایی سیستمهای ایمنی Gemini ابراز شد.

مسائل اخلاقی و استانداردهای صنعتی

مقایسه مدلهای هوش مصنوعی رویهای رایج در صنعت فناوری است که برای شناسایی نقاط قوت و ضعف مدلها استفاده میشود. بااینحال، روشهای مورد استفاده در این ارزیابیها گاهی پرسشهای اخلاقی را مطرح میکند. استفاده گوگل از Claude برای ارزیابی Gemini بحثهایی درباره شفافیت و انطباق با استانداردهای صنعتی برانگیخته است.

مکنامارا دفاع کرد که مقایسه خروجی مدلها بخشی استاندارد از فرآیند توسعه سیستمهای هوش مصنوعی است و تأکید کرد که Claude مستقیماً در آموزش Gemini به کار نرفته است.

چالشهای توسعه Gemini

مکاتبات داخلی همچنین چالشهای گستردهتری در تیم Gemini گوگل را نشان داد. برخی پیمانکاران ابراز نگرانی کردهاند که از آنها خواسته شده پاسخهای Gemini را در حوزههایی مانند سلامت ارزیابی کنند که در آن تخصص کافی ندارند. این وضعیت میتواند منجر به اشتباهات در خروجیهای Gemini شود، بهویژه در موضوعات حساس.

گزارشهای قبلی نشان دادهاند که برخی پیمانکاران احساس میکنند برای ارزیابی محتوای تولیدشده توسط Gemini در حوزههای تخصصی آمادگی کافی ندارند. این امر سوالات بیشتری درباره دقت فرآیندهای ارزیابی و بهبود Gemini ایجاد کرده است.

مسیر پیشرو

با تشدید رقابت در فضای هوش مصنوعی، بررسی دقیق اینگونه فعالیتها احتمالاً افزایش خواهد یافت. استفاده گوگل از Claude بهعنوان معیاری برای Gemini اهمیت بالای توسعه سیستمهای پیشرفته هوش مصنوعی را نشان میدهد. بااینحال، سوالات اخلاقی و رویهای مطرحشده بر نیاز به شفافیت و پاسخگویی بیشتر در این صنعت تأکید دارد.

نتیجه این بحثها میتواند پیامدهای مهمی برای گوگل و Anthropic داشته باشد، زیرا این دو شرکت در حال مدیریت پیچیدگیهای همکاری، رقابت و تطابق با قوانین در صنعت در حال تحول هوش مصنوعی هستند.

جدول افزایش قیمت بنزین را ببینید/ وضعیت تغییرات در عید نوروز

جدول افزایش قیمت بنزین را ببینید/ وضعیت تغییرات در عید نوروز  عکس پروفایل مخصوص روز زن ،مادر و ولادت حضرت فاطمه (س)

عکس پروفایل مخصوص روز زن ،مادر و ولادت حضرت فاطمه (س)  بهترین هتلهای کوش آداسی برای یک اقامت دلچسب

بهترین هتلهای کوش آداسی برای یک اقامت دلچسب  عکس پروفایل مادر فوت شده

عکس پروفایل مادر فوت شده  عکس صبح بخیر زمستانی | 130 عکس نوشته صبح بخیر زمستانی

عکس صبح بخیر زمستانی | 130 عکس نوشته صبح بخیر زمستانی  نکات مهمی که قبل از خرید مبل راحتی باید بدانیم

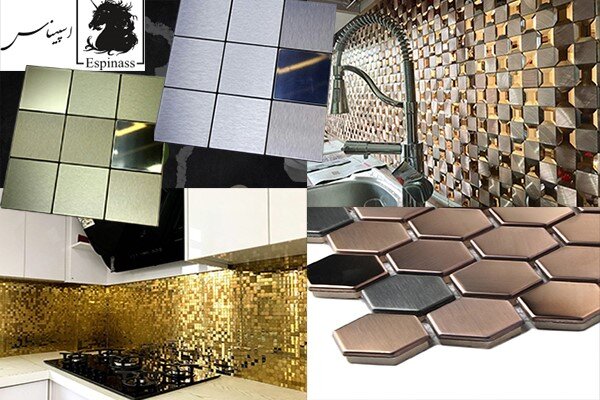

نکات مهمی که قبل از خرید مبل راحتی باید بدانیم  نسل جدید کاشیهای بین کابینتی ـ تایلهای لوکس

نسل جدید کاشیهای بین کابینتی ـ تایلهای لوکس  عکس پروفایل روز مادر _ عکس نوشته مادرانه

عکس پروفایل روز مادر _ عکس نوشته مادرانه  متن تبریک کریسمس | 70 پیام کریسمس فارسی و انگلیسی باکلاس

متن تبریک کریسمس | 70 پیام کریسمس فارسی و انگلیسی باکلاس