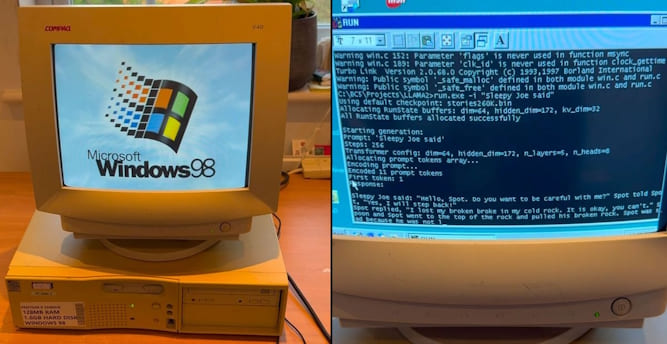

در شاهکاری شگفتانگیز، تیمی از پژوهشگران EXO Labs موفق شدند مدل زبانیلاما 2 را روی سیستمی قدیمی با ویندوز 98، پردازنده پنتیوم II و تنها 128 مگابایت حافظه رم اجرا کنند. این دستاورد که در قالب یک ویدئو در شبکههای اجتماعی به نمایش گذاشته شد، نشان میدهد که این مدل با سرعت قابل قبول 35.9 توکن در ثانیه، قادر به تولید متن است. پیشنهاد میکنیم خودتان این ویدئو جالب را ببینید.

در این ویدئو، یک کامپیوتر قدیمی با برند Elonex و پردازنده پنتیوم II با فرکانس 350 مگاهرتز دید میشود که ویندوز 98 را اجرا میکند. سپس تیم EXO موتور پردازش اختصاصی خود را که بر اساس کد ساده و قدرتمند Llama2.c از آندری کارپاتی طراحی شده، اجرا میکند. این مدل حتی توانست داستانی با موضوع «جو خوابآلود» را با سرعتی قابل قبول تولید کند.

پروژه بلندپروازانه BitNet

EXO Labs، سازمانی که اخیراً از پشت پرده فعالیتهای خود پردهبرداری کرده، مأموریت خود را «دموکراتیزه کردن دسترسی به هوش مصنوعی» تعریف کرده است. این تیم که از پژوهشگران دانشگاه آکسفورد تشکیل شده، به دنبال ایجاد زیرساختهای باز برای آموزش و اجرای مدلهای پیشرفته هوش مصنوعی روی هر دستگاهی است. اجرای موفقیتآمیز مدل لاما روی ویندوز 98، نمادی از این چشمانداز است تا نشان دهد که هوش مصنوعی میتواند روی منابعی با سختافزار محدود نیز قابل اجرا باشد.

اجرای چنین پروژهای روی سیستمی با قدمت 26 سال با چالشهای فراوانی همراه بود. از جمله انتقال دادهها به این سیستم قدیمی که با استفاده از پروتکل FTP و پورت اترنت انجام شد. بزرگترین چالش، اما، تطبیق کدهای مدرن با ویندوز 98 بود. تیم EXO با استفاده از IDE قدیمی Borland C++ 5.02 و چند تغییر کوچک، توانستند کدهای Karpathy را برای این سیستم سازگار کنند.

به گفته یکی از اعضای تیم، الکس چیما، مدل 260 هزار پارامتری لاما با معماری اختصاصی و بهینه، توانست با سرعت 35.9 توکن در ثانیه اجرا شود. اما با افزایش پیچیدگی مدلها، سرعت کاهش یافت؛ به طوری که مدل 15 میلیون پارامتری تنها با سرعت 1 توکن در ثانیه و مدل بزرگتر 1 میلیارد پارامتری با سرعت بسیار پایین 0.0093 توکن در ثانیه اجرا شد.

این پروژه تنها بخشی از برنامه بزرگتر EXO با عنوان BitNet است. BitNet مدلی با معماری ترانسفورمر و وزنهای سهتایی است که به گفته EXO، میتواند یک مدل 7 میلیارد پارامتری را تنها در 1.38 گیگابایت ذخیرهسازی کند. این فناوری جدید نه تنها نیاز به سختافزارهای گرانقیمت و به ویژه شتاب دهنده گرافیکی را از بین میبرد، بلکه 50 درصد کارآمدتر از مدلهای دقیق عمل میکند. به ادعای تیم EXO، یک مدل 100 میلیارد پارامتری BitNet حتی روی یک پردازنده مرکزی معمولی میتواند با سرعت خوانش انسانی اجرا شود.

EXO Labs همچنان به دنبال همکاریهای جدید است. این سازمان از افرادی که علاقهمند به جلوگیری از انحصار هوش مصنوعی توسط شرکتهای بزرگ هستند، دعوت به همکاری کرده است. همچنین، علاقهمندان میتوانند در کانال Discord این تیم، درباره اجرای مدلهای هوش مصنوعی روی سختافزارهای قدیمی، مانند مکهای قدیمی، گیمبویها و Raspberry Pi، به بحث بپردازند.

این پروژه نشان میدهد که آینده هوش مصنوعی میتواند فراتر از مراکز داده گرانقیمت باشد و بهسادگی در دسترس همگان قرار گیرد.

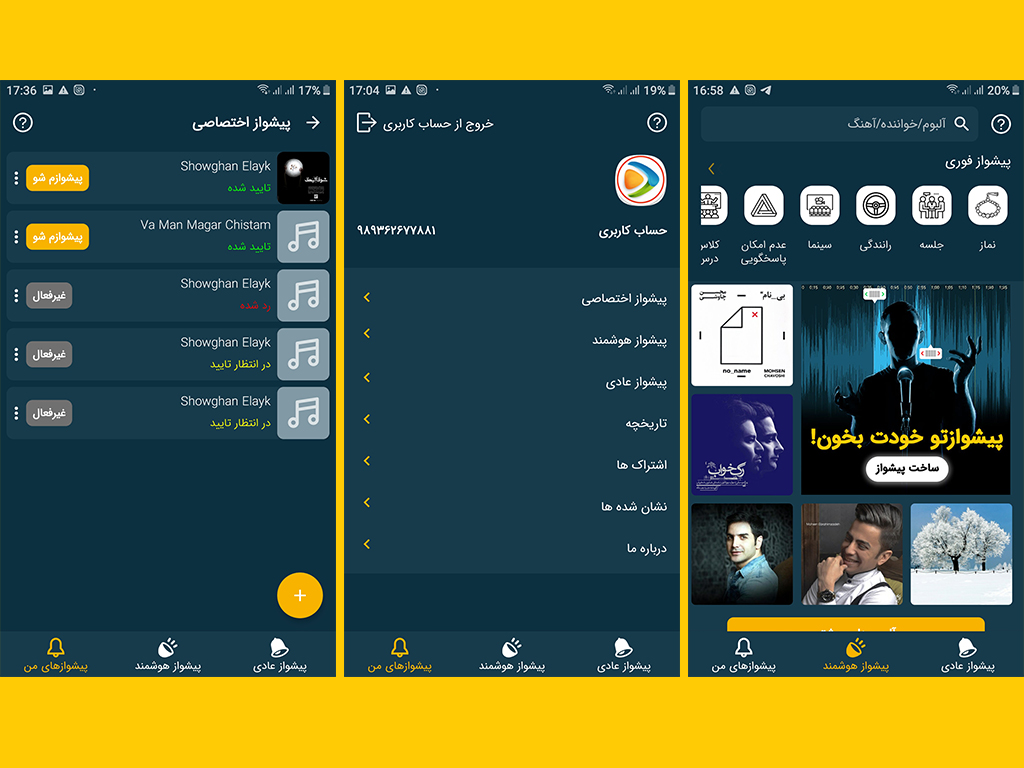

نسخۀ جدید اپلیکیشن «پیشواز هوشمند» ارائه شد

نسخۀ جدید اپلیکیشن «پیشواز هوشمند» ارائه شد  بازی Watch Dogs: Legion و 10 نکته برای تازه واردها

بازی Watch Dogs: Legion و 10 نکته برای تازه واردها  دانلود آهنگ خاص و بی نظیر اجتماعی سارینا از شاهین نجفی

دانلود آهنگ خاص و بی نظیر اجتماعی سارینا از شاهین نجفی  اینفینیکس زیرو ایکس، ایکس پرو و ایکس نئو با دوربین پریسکوپ معرفی شدند

اینفینیکس زیرو ایکس، ایکس پرو و ایکس نئو با دوربین پریسکوپ معرفی شدند  اولین تیزر ویدیویی سدان KMC J7 کرمان موتور منتشر شد

اولین تیزر ویدیویی سدان KMC J7 کرمان موتور منتشر شد  آهنگ جدید زنگ سامسونگ ، توسط BTS ساخته شده است + نسخه صوتی آهنگ

آهنگ جدید زنگ سامسونگ ، توسط BTS ساخته شده است + نسخه صوتی آهنگ  راهنمای خرید و بهترین سیستم های کامپیوتر پیشنهادی بر اساس قیمت و کاربرد (مهر 1403)

راهنمای خرید و بهترین سیستم های کامپیوتر پیشنهادی بر اساس قیمت و کاربرد (مهر 1403)  بهترین بازی های ترسناک دو نفره که باید تجربه کنید

بهترین بازی های ترسناک دو نفره که باید تجربه کنید  فردا 511 محصول جدید خودروسازی فردا رونمایی شد (همراه با ویدئو)

فردا 511 محصول جدید خودروسازی فردا رونمایی شد (همراه با ویدئو)  قیمت پالتو پوست خرگوش و گرگ ضخیم

قیمت پالتو پوست خرگوش و گرگ ضخیم  بهترین پردازنده کامپیوتر، CPU های پیشنهادی + راهنمای خرید

بهترین پردازنده کامپیوتر، CPU های پیشنهادی + راهنمای خرید  هزینه اشتراک ماهانه یوتیوب گران شد

هزینه اشتراک ماهانه یوتیوب گران شد  حبس کودک 3 ساله داخل کشو از زمان تولد توسط مادرش

حبس کودک 3 ساله داخل کشو از زمان تولد توسط مادرش  معرفی سه سریال برتر با موضوع دزدان دریایی و جزیره گنج

معرفی سه سریال برتر با موضوع دزدان دریایی و جزیره گنج  گلکسی زد فلیپ 3 سامسونگ معرفی شد

گلکسی زد فلیپ 3 سامسونگ معرفی شد  آموزش نحوه پنالتی زدن در PES 2021 | چگونه پنالتیها را گل کنیم؟

آموزش نحوه پنالتی زدن در PES 2021 | چگونه پنالتیها را گل کنیم؟